26 juni 2023

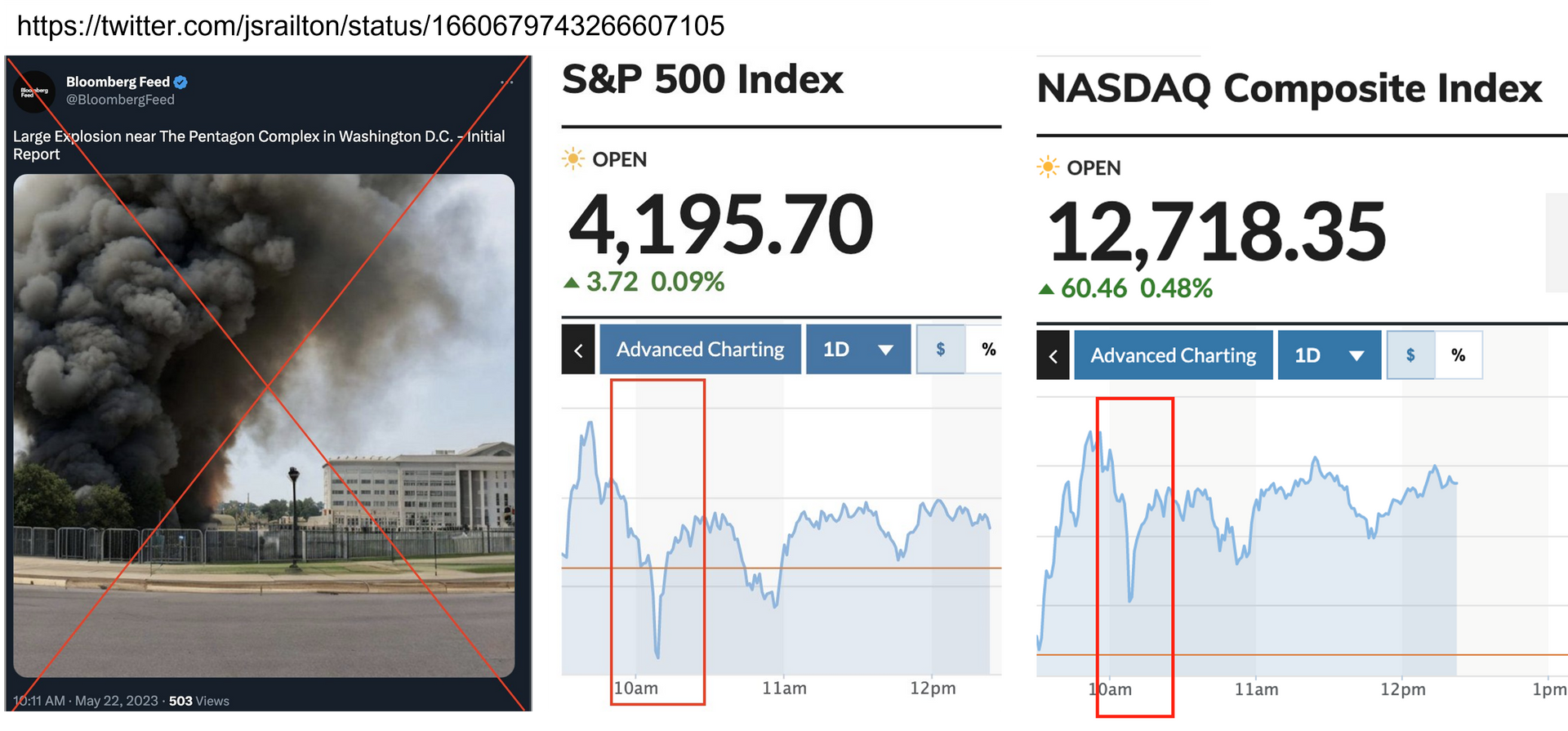

Het is even geleden dat een update geplaatst werd, schandalig want de ontwikkelingen buitelden over elkaar heen afgelopen jaar. Werd vorig jaar nog vooral gesproken over deepfakes (beeld/geluid) en synthetische media, sinds dit jaar zien we overal de term generative AI en tools voor het genereren van tekst, zoals ChatGPT. Hoewel er bijna dagelijks nieuwe mogelijkheden verschijnen, blijft de grote lijn hetzelfde. (1) Iedereen kan straks alles wat digitaal (te maken) is klonen, manipuleren en/of genereren en (2) al rond 2025 is naar verwachting 90% van alle digitale content synthetisch, dus met AI gemanipuleerd of gegenereerd. Dit zal een enorme impact hebben. We kunnen niet meer vertrouwen op onze eigen waarneming. Hoe weet je in welke mate je gemanipuleerd wordt, hoe behoud je vertrouwen? Hierover ging de eerste, door politie geïnitieerde, rijksbrede werkconferentie “impact van synthetische media & deepfakes”. Op iBestuur is recent een blog geplaatst met belangrijkste stappen die we kunnen zetten. In deze nieuwsbrief heb ik de nieuwtjes gegroepeerd in beeld, geluid (stemklonen!) en tekst. Door deze te combineren kun je er volledig autonome digitale personages (avatars) mee creëren en voor je laten werken. Ter afsluiting ook nog iets over detectietools. Beeld Er is een duidelijke toename van beeldmateriaal van kindermisbruik gecreëerd met AI tools . Op TikTok worden in true crime stories, steeds vaker deepfakes van slachtoffers , vooral kinderen, gebruikt, wat enorme impact op betrokkenen kan hebben. Het genereren van afbeeldingen ter ondersteuning van je verhaal kan ook ten koste gaan van je geloofwaardigheid zoals Amnesty mocht ervaren. Het vooraf transparant aangeven dat en waarom je ervoor kiest (zoals beschermen betrokkenen) helpt. Een overzicht van overwegingen bij de inzet van deepfakes vind je hier . Een gegenereerde foto van een explosie bij het Pentagon getwitterd door een schijnbaar betrouwbaar account van Bloomberg zorgde voor een dip in de beurzen. • De schroom om deepfake beelden te gebruiken voor politieke doeleinden verdwijnt steeds verder. De Republikeinse presidentskandidaat DeSantis heeft er geen enkele moeite mee om deepfake beelden van zijn rivaal Trump te verspreiden (die er zelf ook gretig gebruik van maakt). Steeds vaker worden video’s met niet bestaande personen (avatars) ingezet voor het verspreiden van desinformatie, ook door overheden, bijvoorbeeld in Burkina Fasou en Venezuela . Mooie voorbeelden van de laatste mogelijkheden van beeldbewerking zijn DragGan en de opties die Adobe nu biedt. Audio Er komen steeds meer toepassingen waarbij je jouw stemkloon kunt inzetten, Microsoft heeft aangetoond dat 3 seconden geluid voldoende is. In dit artikel worden 11 tools beschreven. Gek genoeg staat Elevenlabs hier niet bij, terwijl zij juist zoveel misbruikt werden, bijvoorbeeld om de stem van Emma Watson uit Mein Kampf te laten voorlezen. Denk dus na voor je iets op TikTok plaatst, een fragment van je stem is voldoende om te klonen. Hier een voorbeeld van hoe je er persoonlijke gegevens mee kunt ontfutselen. We zien dit ook steeds meer terugkomen bij verschillende vormen van CEO en Vriend-in-Nood-Fraude toegepast worden. Er kan ook emotie aan de stemkloon meegegeven worden, zo werd deze moeder overtuigd dat haar dochter ontvoerd was. Het wordt extra effectief met een combinatie van gezicht en stem… In deze post heb ik wat tips opgenomen waarmee je kunt voorkomen erin te trappen. Steeds meer organisaties zijn overgestapt op biometrische authenticatie, en zij lopen er nu tegenaan dat dit hun systeem verzwakt. Al veel langer is het mogelijk om met het gezicht van iemand anders een bankrekening te openen. Banken, maar ook andere organisaties zoals de belastingdienst in Australië , gebruiken ook de stem als biometrische controle voordat ze iemand toegang geven. Vice laat zien dat deze systemen niet bestand zijn tegen stemklonen. Swatting as a service , een dienst die opnames met nepstemmen aanbiedt die je kunt inzetten om de politie ergens een inval te laten doen. $50 om je school een dagje plat te leggen, en voor $75, laat je ze iemands huis binnenvallen en doorzoeken… Zeer zorgelijk gezien de politiecapaciteit die hiermee verspild wordt en de emotionele impact op betrokkenen. Samsung kondigde recent de mogelijkheid aan om via tekst-to-speech je stemkloon een gesprek in stilte te laten voeren als je ergens bent waar je niet kunt praten. Koppel het aan toepassingen als ChatGPT en je hoeft helemaal het gesprek niet meer te voeren😉 Tekstsynthese (Large Language Models, ChatGPT) Tekstmodellen kunnen op veel manieren ondersteunen en brengen eindeloos veel nieuwe mogelijkheden voor mensen die ergens leek in zijn of minder taalvaardig. Neem dit voorbeeld voor het ontwerpen van een tomatenpluk-machine , of hoe ChatGPT je kan helpen in een live sollicitatie gesprek . Als je echt een goed beeld wilt krijgen van de betekenis (het grotere plaatje), dan raad ik de podcast The AI Dilemma aan, beste dat ik afgelopen tijd hoorde! Het gaat vaak mis met ChatGPT en vergelijkbare tools. Mensen willen het gebruiken als zoekmachine, maar het is ontwikkeld om voor jou teksten te genereren, dus als jij bronnen wilt hebben, dan krijg je die, maar die hoeven niet echt te bestaan zoals deze advocaat merkte toen hij jurisprudentie zocht. Mensen kunnen er ook echt door beschadigd worden. Zoals een burgemeester ervaarde, die volgens ChatGPT in de gevangenis had gezeten, of de man die geld verduisterd zou hebben en de professor zogenaamd betrokken bij sexueel misbruik . Als mensen naar je gaan zoeken via ChatGPT, kunnen de gekste dingen opkomen. Spannend wordt of het lukt om OpenAI, het bedrijf achter ChatGPT aan te klagen… Voor wie het toch wil gebruiken vast een tip, hoe overtuigender het antwoord van AI, hoe groter de kans dat het niet klopt ! Door het combineren van de mogelijkheden van deepfake audio en video met ChatGPT die de gesprekken genereert, kun je (semi) autonome personages (avatars/digital humans) creëren die aan de hand van een aantal mee gegeven intenties zelf gesprekken en relaties aangaan en aan hun handelen invulling geven. Zo kun je een kloon van je zelf tegen vergoeding beschikbaar stellen, bijvoorbeeld als virtuele vriendin . In de praktijk blijkt het echter lastig af te bakenen hoe ver jouw kloon mag gaan… In dit artikel meer commerciële toepassingen (denk aan dienstverlening, trainingen) en diverse dreigingen. Ook kun je (meerdere) avatars autonoom aan het werk zetten in de metaverse. Dit werk kan echter ook inhouden het verspreiden van gedachtengoed en ronselen van mensen… Hier een voorbeeld van de eerste experimenten met volledig autonome “mensen” in een “metaverse” die zelf op basis van intentie hun activiteiten en doelen van de dag bepalen en op basis daarvan onderling interacteren. Er is een aparte nieuwsbrief over de Metaverse, laat het me weten als je die wilt ontvangen! AI-detectietools Met de opkomst van AI groeit ook de vraag naar AI-detectietools, ik heb bewust geen overzicht opgenomen, want ze vormen ook een risico als we erop gaan vertrouwen (en weet je wie achter de tools zitten, dus met wie je tekst/beeld deelt?). Van deepfake-detectietools is bekend dat ze niet goed werken. Ze detecteren maar een deel van de fakes en ze merken soms ook betrouwbare content aan als fake. Ook laat recent onderzoek naar detectietools voor door studenten met AI-gegenereerde tekst zien dat deze een bias kennen naar non-native Engelssprekenden. Hun werk wordt veel vaker als AI-generated (“fake”) aangemerkt dan dat van native sprekers. Als in 2027 90% van de content met AI gegenereerd of gemanipuleerd is, vraag ik me ook af wat de meerwaarde is van het weten dat AI gebruikt is? Het gaat uiteindelijk om wat je met de informatie wilt doen, dat bepaalt de relevantie van de manipulaties… Onderzoek daarom zelf in welke context de informatie gegenereerd is en toets dat aan de context waarin jij het wilt toepassen. Wat gaat helpen zijn de initiatieven op het gebied van provenance, internationaal zijn grote consortia van camerabedrijven, nieuwsmedia (oa BBC), Google, Microsoft, Adobe, Truepic en vele anderen hiermee bezig. Ook op de rijksbrede werkconferentie werd dit als een belangrijke oplossingsrichting gezien. Wil je meer weten over provenance, bekijk dan deze toelichting . Heb je vragen, zelf interessante links, laat het me weten via het contactformulier!